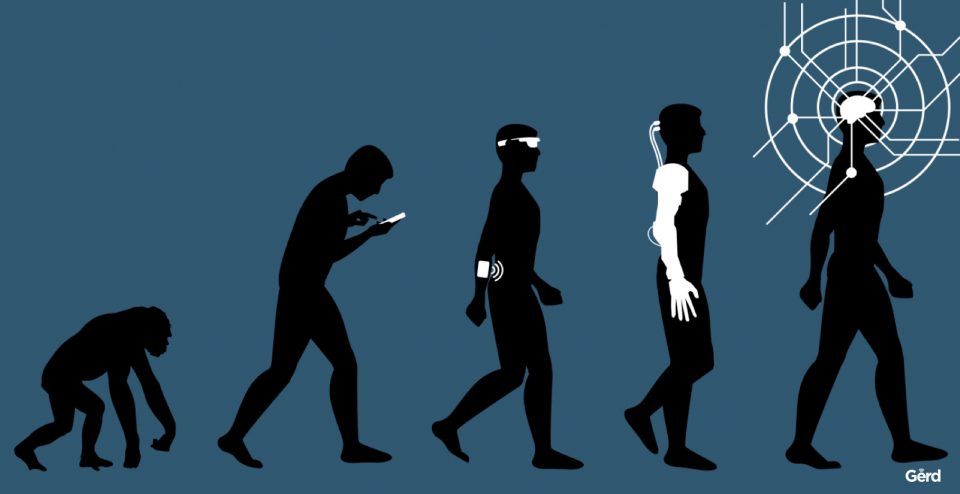

Verdaderas eminencias en los diferentes campos de la ciencia se han planteado esta interrogante, llegando a diferentes conclusiones en torno al futuro que nos depara la investigación y los avances de la Inteligencia Artificial (IA).

El físico británico Stephen Hawking alertó sobre los peligros de la Inteligencia Artificial, mencionando que incluso la misma podría significar el fin de la raza humana, si nosotros permitíamos que las máquinas superen en inteligencia a los seres humanos. También, Elon Musk, genio innovador de nuestra época, en diferentes ocasiones ha recalcado que esta tecnología puede ser igual de peligrosa que las armas nucleares, y de allí la urgencia de establecer lineamientos globales para su desarrollo.

Pero, ¿en que radica el temor a la inteligencia artificial?, ¿qué tan perjudicial puede ser para los seres humanos?

Generalmente al igual que otras tecnologías innovadoras, el riesgo radica en el desconocimiento, sin embargo, las opiniones planteadas anteriormente, representan el pensamiento de dos de las mentes mas preparadas del último siglo, siendo así, nos permitimos intuir que el temor se basa en las grandes expectativas que existen en el desarrollo de la inteligencia artificial, y en la capacidad que tengamos los seres humanos para convertirlas en una herramienta o en un arma.

Ante lo expuesto, el aspecto ético es vital en lo referente a la IA, siendo un tema que va cobrando mayor interés por parte de los países que ven cada día más inmersa la IA en todas las actividades cotidianas, es así que la Comunidad Europea puso a cargo de un grupo de expertos la elaboración de un borrador con las directrices éticas para el desarrollo y uso de la inteligencia artificial. El documento consta de 37 páginas y resalta la importancia de garantizar el respeto a los derechos humanos y los valores fundamentales de los ciudadanos, basándose en los siguientes principios:

- Principio de beneficencia: “hacer el bien”.

- Principio de no maleficencia: “no hacer daño”.

- Principio de autonomía de los seres humanos.

- Principio de justicia.

- Principio de transparencia.(Group, 2018)

Se puede observar que persiste el interés por dejar claro que la Inteligencia Artificial busca ante todo el bienestar de los seres humanos, sin embargo, los temores crecen apoyados por la visión apocalíptica presentada por el cine y la ciencia ficción en general: Máquinas revelándose contra sus creadores, programas informáticos que toman el control. Recientemente se está centrando la atención en temores más reales como: la pérdida de empleo al verse desplazado por mecanismos autónomos y mas eficientes, y la pérdida de privacidad de nuestra información personal. Esto ha permitido que se consideren también ciertos riesgos relevantes en el desarrollo de la IA:

- Identificación sin consentimiento.

- Sistemas de inteligencia artificial encubiertos.

- Desviación de los derechos fundamentales mediante puntaje normativo y de ciudadanía sin consentimiento.

- Sistemas letales de armas autónomas.

- Riesgos Potenciales aún no definidos(Group, 2018).

Analizando los riesgos y los principios que propone la Comunidad Europea para el desarrollo de la inteligencia artificial hay que resaltar que los temores más reales se pueden evitar con la aplicación de la tecnología basada en principios éticos, orientándose a buscar soluciones eficientes a problemas cotidianos. Tenemos mucho por ganar con la IA, detección temprana de enfermedades, optimización de procesos que reduzcan índices de contaminación, detección y prevención de fraudes, seguridad, e incontables aplicaciones relacionadas con la medicina, la física, la química, la electrónica, las telecomunicaciones, las ciencias sociales y todo aquello que nuestra mente pueda imaginar y modelar.

El primer paso es responsabilidad de los gobiernos de cada país para garantizar el desarrollo de esta tecnología de manera ética y confiable, basada en el cumplimiento de los siguientes requerimientos:

- Responsabilidad.

- Gobierno de datos.

- Diseño para todos.

- Gobernanza de la autonomía de la IA (supervisión humana).

- No discriminación.

- Respeto por (y mejora de) la autonomía humana.

- Respeto a la privacidad.

- Robustez.

- Seguridad.

- Transparencia (Group, 2018).

Bibliografía

Group, T. E.-L. (2018). Draft Ethics Guidelines For Trustworthy AI. Obtenido de https://ec.europa.eu/digital-single-market/en/news/draft-ethics-guidelines-trustworthy-ai